财联社5月15日电(编辑石)北京时间周三凌晨1点起,谷歌在山景城总部附近的海岸线圆形剧场举行了一年一度的I/O开发者大会,发表了长达两个小时的主题演讲。

不出所料,Google基本上讲了AI,AI,AI,AI,AI,AI。据大会官方最终统计,艾在主题演讲中被提及120次。而且这还只统计了听课笔记,实际数量会更多。

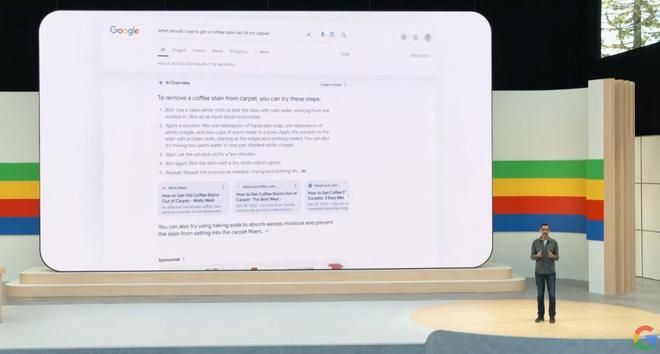

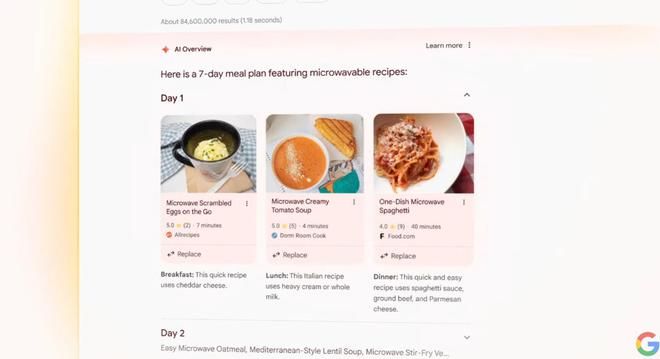

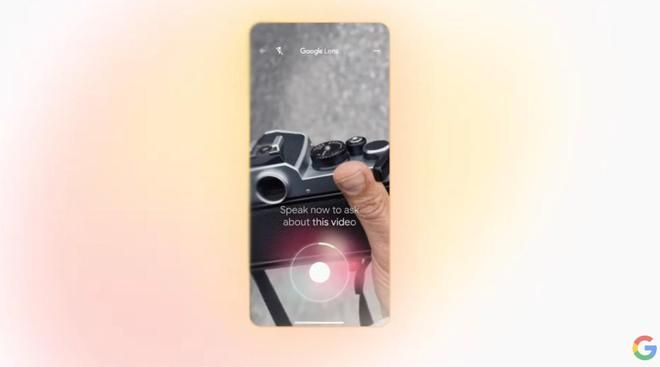

在一大堆更新和新发布的功能中,也有很多产品带有记忆点。例如,从本周开始,谷歌搜索引擎将在美国推出“AI Overviews”功能,搜索引擎将直接汇总搜索结果。同时,Google搜索还将具备多步推理能力,可以一次性处理多个限制的长篇问题,支持“拍摄视频”搜索解决方案的新搜索形式。

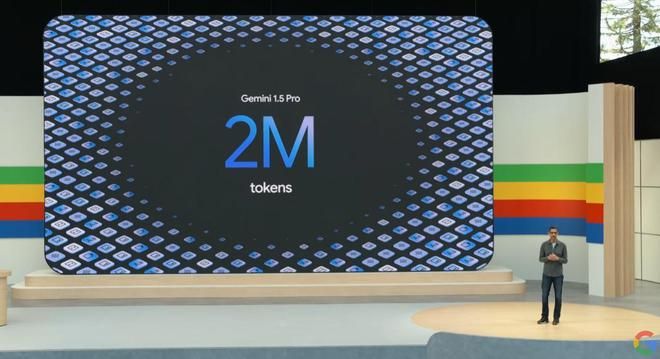

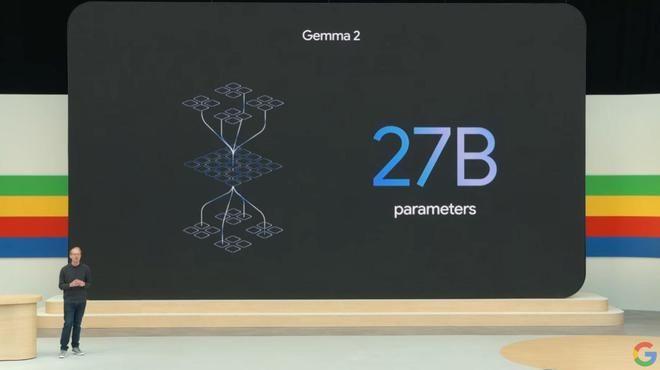

此外,以“长”窗口闻名的Gemini 1.5 Pro模型将在今年晚些时候进一步将100万令牌的窗口扩展到200万令牌,扩展多模态信息同时处理的边界。针对一些需要快速响应的场景,Google还推出了Gemini 1.5 Flash模型。今年2月刚出的Gemma开源机型,下个月也将迎来参数更大的Gemma 2。在多模态领域,谷歌也发布了学生画图工具Imagen 3和YouTube & amp;音乐人与最新视频生成模型Veo合作的“AI音乐沙盒”。多模态Gemini Nano模型也将在今年晚些时候登陆Pixel手机,这是一个在本地运行的机载模型。

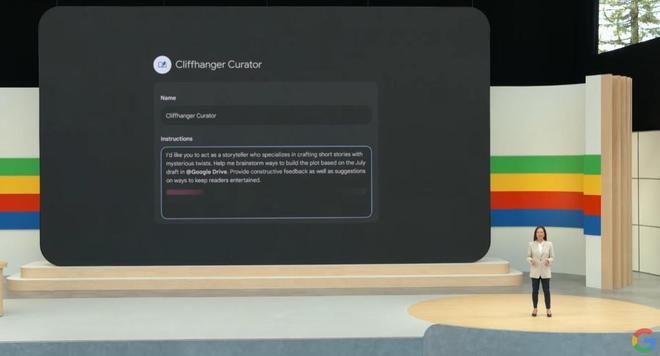

值得一提的是,Google的发布会和昨天的OpenAI发布会也有一些相似之处——实时AI助手。从今年夏天开始,Gemini还将支持实时语音交互,今年晚些时候还将推出实时视频交互。未来几个月,谷歌还将推出类似于GPTs的定制AI助手功能,名为Gems,可以与整套“谷歌家族桶”联动。

硬件方面,谷歌公布了第六代TPU芯片Trillium,并透露明年初可以使用英伟达最新的Blackwell架构GPU。此外,液冷、光缆等中国投资者可能感兴趣的话题也出现在发布会上。

-整场发布会回顾-

发布会开始,Alphabet&谷歌CEO桑达尔·皮查伊登上舞台。  发布会开始,alphabet & amp;谷歌首席执行官桑达尔·皮查伊(sundar pichai)走上舞台。

发布会开始,alphabet & amp;谷歌首席执行官桑达尔·皮查伊(sundar pichai)走上舞台。

皮查伊表示,现在已经有超过150万开发者正在使用谷歌的人工智能Gemini,今天将展示一系列有关搜索、图片、工作套件、安卓系统等等与人工智能有关的案例。  皮查伊表示,现在有超过150万开发者在使用谷歌的人工智能双子座,今天将展示搜索、图片、工作套件、安卓系统等一系列与人工智能相关的案例。

皮查伊表示,现在有超过150万开发者在使用谷歌的人工智能双子座,今天将展示搜索、图片、工作套件、安卓系统等一系列与人工智能相关的案例。

皮查伊宣布,能够总结谷歌搜索引擎结果的“AI概览”(AI Overviews)功能,将于本周在美国推出。  皮查伊宣布,可以汇总谷歌搜索引擎结果的“AI Overviews”功能,将于本周在美国推出。

皮查伊宣布,可以汇总谷歌搜索引擎结果的“AI Overviews”功能,将于本周在美国推出。

基于Gemini支持,谷歌图片(Google Photos)将支持用户存储图片的AI搜索,例如“告诉我,我的车牌号码是多少?”——这个名为Ask Photos的功能将于今年夏天推出。  基于对Gemini的支持,Google Photos将支持对用户存储图片的AI搜索,比如“告诉我,我的车牌号是多少?”-这个名为Ask Photos的功能将于今年夏天推出。

基于对Gemini的支持,Google Photos将支持对用户存储图片的AI搜索,比如“告诉我,我的车牌号是多少?”-这个名为Ask Photos的功能将于今年夏天推出。

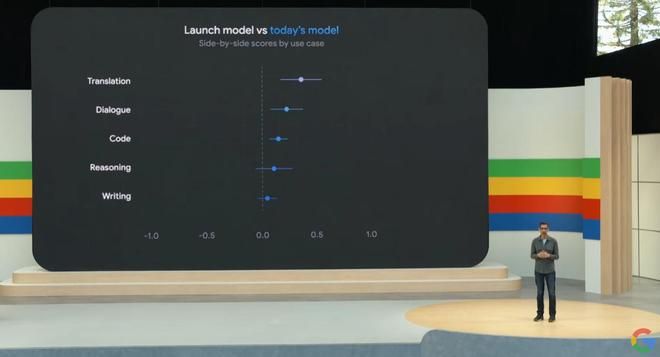

皮查伊宣布,最新版本的Gemini 1.5 Pro(在多项核心功能方面均较最初发布版本有所提高)现在向全球所有开发者开放。从今天开始,支持100万tokens上下文窗口的Gemini 1.5 Pro将在Gemini Advanced功能下向用户开放,支持35种语言。  皮查伊宣布,Gemini 1.5 Pro的最新版本(在很多核心功能上比原版更好)现已面向全球所有开发者开放。今日起,支持100万令牌上下文窗口的双子1.5 Pro将在双子高级功能下向用户开放,支持35种语言。

皮查伊宣布,Gemini 1.5 Pro的最新版本(在很多核心功能上比原版更好)现已面向全球所有开发者开放。今日起,支持100万令牌上下文窗口的双子1.5 Pro将在双子高级功能下向用户开放,支持35种语言。

谷歌同时面向开发者推出支持200万tokens的Gemini 1.5 Pro模型的预览,并表示最终的目标将是“无限上下文”。  Google还为开发者推出了支持200万令牌的Gemini 1.5 Pro模型预览版,并表示最终目标将是“不限上下文”。

Google还为开发者推出了支持200万令牌的Gemini 1.5 Pro模型预览版,并表示最终目标将是“不限上下文”。

谷歌AI业务总负责人、DeepMind的首席执行官杰米斯·哈萨比斯登台,宣布推出Gemini 1.5 Flash大模型。这个模型兼具速度与效率,和多模态推理能力,以及长达100万tokens的上下文窗口。开发者将能够申请体验200万tokens的上下文窗口的Gemini 1.5 Flash。  谷歌AI业务首席执行官、DeepMind首席执行官杰米·哈萨比斯(Jamie Hassabis)上台,宣布推出双子座1.5 Flash模型。该模型兼具速度和效率、多模态推理能力和100万个表征的上下文窗口。开发者将可以申请Gemini 1.5 Flash来体验200万令牌的上下文窗口。

谷歌AI业务首席执行官、DeepMind首席执行官杰米·哈萨比斯(Jamie Hassabis)上台,宣布推出双子座1.5 Flash模型。该模型兼具速度和效率、多模态推理能力和100万个表征的上下文窗口。开发者将可以申请Gemini 1.5 Flash来体验200万令牌的上下文窗口。

谷歌展示“未来的人工智能助手”——名为“Astra”的项目。哈萨比斯表示,这样的AI助手需要像人类一样理解这个动态且复杂的世界。需要记得住它看到的东西,这样才能理解对话并付诸于行动。同时它也得能积极主动接受教导,以及自然、无延迟地进行交流。在演示视频中,谷歌的AI助手能够通过摄像头视频,识别“什么东西能发出声音”、“现在身处何地”等指令。  谷歌展示“未来人工智能助手”——一个名为“Astra”的项目。哈萨比斯表示,这样的AI助手需要像人类一样理解这个动态复杂的世界。你需要记住它看到了什么,这样你才能理解对话并付诸行动。同时,它必须能够主动接受教学,自然而不拖延地进行交流。在演示视频中,谷歌的AI助手可以通过摄像头视频识别诸如“什么可以发出声音”、“你现在在哪里”等命令。

谷歌展示“未来人工智能助手”——一个名为“Astra”的项目。哈萨比斯表示,这样的AI助手需要像人类一样理解这个动态复杂的世界。你需要记住它看到了什么,这样你才能理解对话并付诸行动。同时,它必须能够主动接受教学,自然而不拖延地进行交流。在演示视频中,谷歌的AI助手可以通过摄像头视频识别诸如“什么可以发出声音”、“你现在在哪里”等命令。

谷歌宣布了一系列与图像、音乐、视频有关的生成式AI工具。包括文生图工具Imagen 3、与Youtube以及音乐家合作的“AI音乐沙盒”,以及最新的视频生成模型Veo。  谷歌宣布了一系列与图像、音乐和视频相关的生成式人工智能工具。包括文学创作工具Imagen 3,与Youtube和音乐人合作的AI音乐沙盒,以及最新的视频生成模型Veo。

谷歌宣布了一系列与图像、音乐和视频相关的生成式人工智能工具。包括文学创作工具Imagen 3,与Youtube和音乐人合作的AI音乐沙盒,以及最新的视频生成模型Veo。

其中最受关注的视频生成模型Veo,能够根据文字、图片和视频的提示,生成高质量1080p视频。  最受关注的视频生成模型Veo,可以根据文字、图片、视频生成高质量的1080p视频。

最受关注的视频生成模型Veo,可以根据文字、图片、视频生成高质量的1080p视频。

哈萨比斯离场,皮查伊重回舞台,发布第六代TPU芯片Trillium,较上一代芯片的算力表现翻4.7倍,云用户从今年下半年开始可以用上新芯片。同时谷歌云将在2025年初,用上英伟达的最新Blackwell架构GPU。  哈萨比斯退场,皮查伊重回舞台发布第六代TPU芯片Trillium,比上一代芯片强大4.7倍。云用户可以从今年下半年开始使用新的芯片。同时,谷歌云将在2025年初使用英伟达最新的Blackwell架构GPU。

哈萨比斯退场,皮查伊重回舞台发布第六代TPU芯片Trillium,比上一代芯片强大4.7倍。云用户可以从今年下半年开始使用新的芯片。同时,谷歌云将在2025年初使用英伟达最新的Blackwell架构GPU。

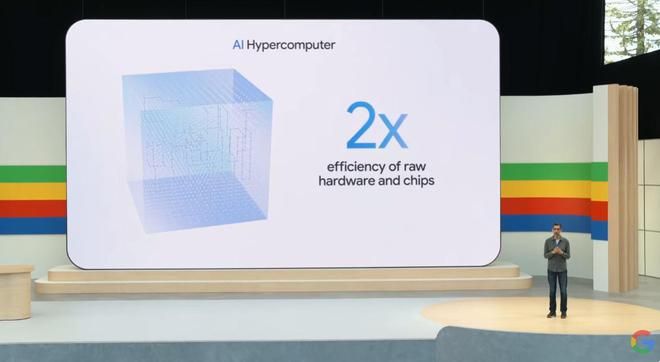

皮查伊开始介绍自家的AI超级计算机,比起用户自己买相同的硬件和芯片,谷歌的架构能使得效能翻倍,其中有部分功劳来自于液冷系统。皮查伊表示,谷歌部署液冷系统的数据中心已经达到1GW,而且还在不断增长中。  皮柴开始介绍自己的ai超级计算机。相比用户购买同样的硬件和芯片,Google的架构可以让效率翻倍,部分功劳来自于液冷系统。皮查伊表示,谷歌部署液冷系统的数据中心已经达到1GW,而且还在不断增长。

皮柴开始介绍自己的ai超级计算机。相比用户购买同样的硬件和芯片,Google的架构可以让效率翻倍,部分功劳来自于液冷系统。皮查伊表示,谷歌部署液冷系统的数据中心已经达到1GW,而且还在不断增长。

皮查伊说,谷歌在地面和海底光纤上投入了200万英里,是第二家云服务商的十倍。

液冷、光缆,应该都是股民们会感兴趣的东西。  液冷和光缆应该都是投资人会感兴趣的东西。

液冷和光缆应该都是投资人会感兴趣的东西。

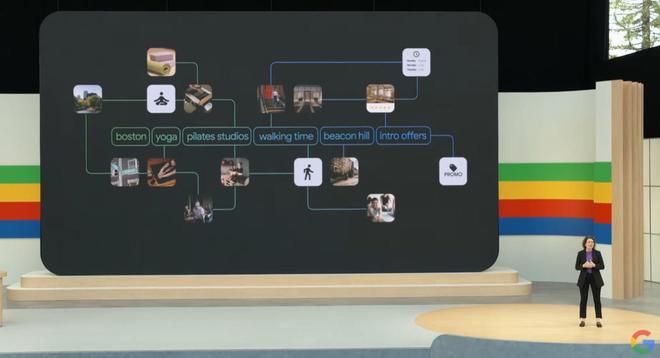

谷歌搜索业务负责人Liz Reid开始具体介绍AI Overviews功能。Reid表示,在进行搜索时,搜素引擎具备多步骤推理的能力,例如寻找一个瑜伽教室,同时展示新手优惠报价,和距离特定位置的步行时间。这个AI搜索引擎助手,还能介绍食谱、安排行程,以及接受视频形式的提问(例如视频中的相机怎么使用)。  谷歌搜索业务负责人Liz Reid开始详细介绍AI Overviews功能。里德表示,在搜索时,搜索引擎具有多步推理的能力,例如找到一个瑜伽教室,同时显示新手优惠和从特定位置出发的步行时间。这款AI搜索引擎助手还可以介绍菜谱、安排行程、接受视频形式的提问(比如视频中的摄像头怎么用)。

谷歌搜索业务负责人Liz Reid开始详细介绍AI Overviews功能。里德表示,在搜索时,搜索引擎具有多步推理的能力,例如找到一个瑜伽教室,同时显示新手优惠和从特定位置出发的步行时间。这款AI搜索引擎助手还可以介绍菜谱、安排行程、接受视频形式的提问(比如视频中的摄像头怎么用)。

在办公套件Workspace方面,谷歌将逐步推出总结、邮件Q&A,以及智能回复等功能。  在office套件工作区,Google将逐步推出summary、email Q&等;一个,又智能的回复。

在office套件工作区,Google将逐步推出summary、email Q&等;一个,又智能的回复。

谷歌Gemini总经理Sissie Hsiao介绍了Gemini App的更新。与周一的OpenAI一样,从今年夏天开始,Gemini也将支持语音实时交互,同时今年晚些时候还将上线实时视频交互功能。未来几个月内,谷歌也将推出类似于GPTs的自定义AI助手功能,叫做Gems。这个AI助手的亮点,将是能与“谷歌全家桶”进行交互。  Google Gemini总经理Sissie Hsiao介绍了Gemini App的更新。和周一的OpenAI一样,Gemini也将从今年夏天开始支持实时语音交互,今年晚些时候也会推出实时视频交互。未来几个月,谷歌还将推出类似于GPTs的定制AI助手功能,名为Gems。这款人工智能助手的亮点将是能够与谷歌家庭桶进行交互。

Google Gemini总经理Sissie Hsiao介绍了Gemini App的更新。和周一的OpenAI一样,Gemini也将从今年夏天开始支持实时语音交互,今年晚些时候也会推出实时视频交互。未来几个月,谷歌还将推出类似于GPTs的定制AI助手功能,名为Gems。这款人工智能助手的亮点将是能够与谷歌家庭桶进行交互。

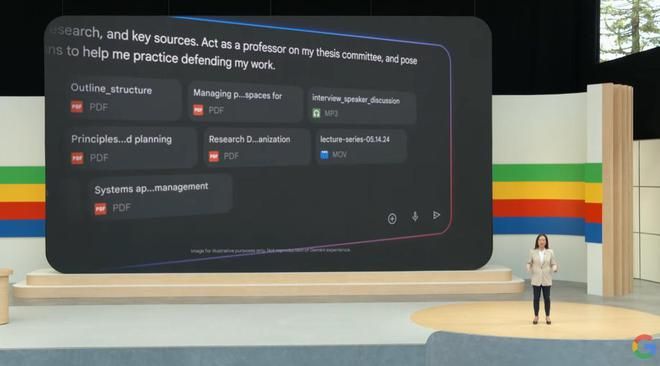

Hsiao再次强调了Gemini的长上下文窗口——能够一次性处理整整1500页的文件,或3万行代码、1小时视频。不同的载体也能混同一起提交给聊天机器人。她再次强调,今年晚些时候上下文窗口将翻倍至200万Tokens。  Hsiao再次强调了Gemini的长上下文窗口——它一次可以处理整整1500页的文件,或者30000行代码和一个小时的视频。不同的载体也可以混合提交给聊天机器人。她再次强调,今年晚些时候,上下文窗口将翻一番,达到200万个令牌。

Hsiao再次强调了Gemini的长上下文窗口——它一次可以处理整整1500页的文件,或者30000行代码和一个小时的视频。不同的载体也可以混合提交给聊天机器人。她再次强调,今年晚些时候,上下文窗口将翻一番,达到200万个令牌。

安卓生态系统的负责人Sameer Samat登台,他将讨论今年安卓系统实现的“三大突破”,分别是“画圈圈搜索”、Gemini手机AI助手,第三是在手机本地运行的AI。  Android生态系统负责人Sameer Samat上台。他将讨论今年Android系统实现的“三大突破”,即“圈子搜索”,双子座手机AI助手,第三个是 AI在手机本地运行。

Android生态系统负责人Sameer Samat上台。他将讨论今年Android系统实现的“三大突破”,即“圈子搜索”,双子座手机AI助手,第三个是 AI在手机本地运行。

谷歌表示,今年晚些时候,能够在本地运行的多模态Gemini Nano模型将登陆Pixel手机,意味着手机将能通过文字、图片、视频、音频,理解用户的世界。举例而言,在听到“帮你把钱转到安全账户”这样的诈骗电话时,手机会自动弹出诈骗警告。整个过程都是在本地运行,不会引发隐私泄露。  谷歌表示,今年晚些时候,可以在本地运行的多模态Gemini Nano模型将登陆Pixel手机,这意味着手机将能够通过文字、图片、视频和音频来了解用户的世界。比如当你听到类似“帮你转账到安全账户”的诈骗电话时,手机会自动弹出诈骗预警。整个过程在本地运行,不会造成隐私泄露。

谷歌表示,今年晚些时候,可以在本地运行的多模态Gemini Nano模型将登陆Pixel手机,这意味着手机将能够通过文字、图片、视频和音频来了解用户的世界。比如当你听到类似“帮你转账到安全账户”的诈骗电话时,手机会自动弹出诈骗预警。整个过程在本地运行,不会造成隐私泄露。

谷歌披露大模型API的最新定价,其中Gemini 1.5 Pro定价为7美元/100万Tokens,12.8K上下文窗口的版本定价为3.5美元/100万Tokens;而Gemini 1.5的起售价为0.35美元/100万Tokens。  Google披露了大模型API的最新定价,其中Gemini 1.5 Pro定价7/100万令牌,12.8K上下文窗口版本定价3.5/100万令牌;双子座1.5的起步价是0.35美元/100万代币。

Google披露了大模型API的最新定价,其中Gemini 1.5 Pro定价7/100万令牌,12.8K上下文窗口版本定价3.5/100万令牌;双子座1.5的起步价是0.35美元/100万代币。

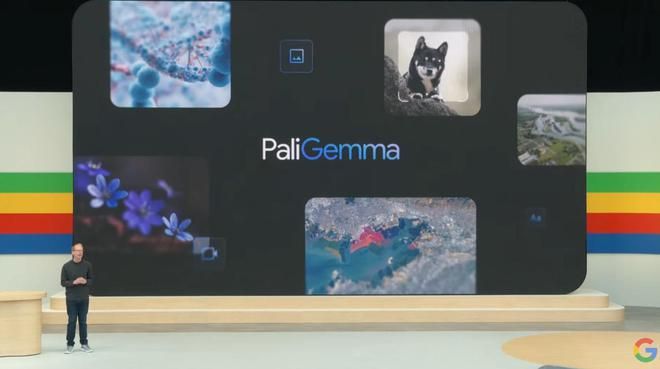

对于在今年二月刚刚推出的轻量级开源模型Gemma,谷歌宣布推出视频语言模型PaliGemma,并将会在6月推出Gemma 2。相较于第一代模型只有20亿和70亿的参数量,第二代开源Gemma的参数量能达到270亿。  对于今年2月刚刚推出的轻量级开源模型Gemma,Google宣布推出视频语言模型 PaliGemma,并将于6月推出Gemma 2。相比第一代模型只有20亿和70亿的参数,第二代开源Gemma可以达到270亿的参数。

对于今年2月刚刚推出的轻量级开源模型Gemma,Google宣布推出视频语言模型 PaliGemma,并将于6月推出Gemma 2。相比第一代模型只有20亿和70亿的参数,第二代开源Gemma可以达到270亿的参数。

作为发布会最后的彩蛋,谷歌CEO皮查伊最后用Gemini总结了今天的发布会稿子里总共提了多少次AI——120次。当然,这并不包括皮查伊问完这个问题后,又唤了几遍AI。  作为发布会的最后一个彩蛋,Google CEO皮查伊最后用双子总结了ai在今天的发布会草稿中被提及了多少次——120次。当然这还不包括皮柴问完这个问题后给ai打了几次电话。

作为发布会的最后一个彩蛋,Google CEO皮查伊最后用双子总结了ai在今天的发布会草稿中被提及了多少次——120次。当然这还不包括皮柴问完这个问题后给ai打了几次电话。

记者招待会结束了